Ciencia & Ambiente Ciencia & Tecnología

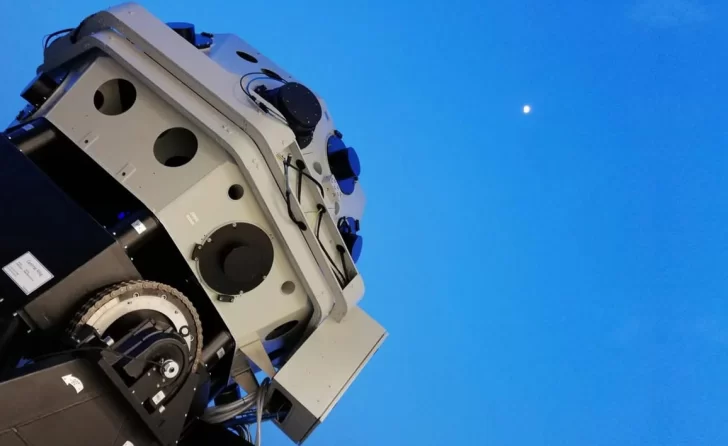

Un nuevo telescopio en Chile para detectar asteroides peligrosos.

El Observatorio Europeo Austral (ESO) y la Agencia Espacial Europea (ESA) han puesto en funcionamiento el Telescopio Test-Bed 2 (TBT2), un instrumento instalado en el observatorio de La Silla, ubicado en Coquimbo, Chile, que vigilará de cerca los asteroides que podrían suponer un riesgo para la Tierra.

El TBT2 de la ESA trabajará junto a su telescopio asociado del hemisferio norte y pondrá a prueba nueva tecnología para una futura red de telescopios, informa el Observatorio Europeo Austral en un comunicado.

El proyecto, una colaboración entre el ESO y la ESA, «es un banco de pruebas para demostrar las capacidades necesarias para detectar y hacer seguimiento de objetos cercanos a la Tierra con el mismo sistema de telescopios«, afirma Clemens Heese, jefe de la sección de Tecnologías ópticas de la ESA y líder del programa.

Si bien en la Tierra los impactos graves de asteroides peligrosos son bastante poco probables, no son imposibles. TBT forma parte del esfuerzo de varias organizaciones por obtener una descripción más completa de estos objetos y de los riesgos potenciales que plantean.

Además, este avance permite testear el hardware y el software para una futura red de telescopios que será robótica: se podrá programar las observaciones en tiempo real y, al final del día, informará de las posiciones y demás información sobre los objetos detectados.

La lista de riesgo.

En la actualidad, se conocen más de 900.000 asteroides en el Sistema Solar, de los cuales más de 25.000 son objetos cercanos a la Tierra ya que su órbita los aproxima a ella. Más de 1.000 de estos objetos están en la lista de riesgos de la ESA, lo que significa que hay que vigilarlos.

Los objetos más grandes son, afortunadamente, más fáciles de detectar, por lo que sus órbitas ya se han estudiado a fondo. Pero, los objetos pequeños y medianos son mucho más numerosos en el sistema solar y estos todavía pueden causar un grave daño, ya que quedan muchos por descubrir.

En la actualidad, los astrónomos utilizan telescopios tradicionales con un estrecho campo de visión para detectar objetos amenazadores provenientes del sistema solar. Dado que estos telescopios solo pueden observar una pequeña porción del cielo a la vez, resulta un proceso lento y tedioso.

Como parte del esfuerzo global para acelerar y mejorar esta búsqueda, la ESA está desarrollando los telescopios Flyeye, cuyo diseño está inspirado en los ojos de algunos insectos, lo que le proporciona un campo de visión mucho más amplio y le permite abarcar grandes regiones del firmamento de forma mucho más rápida que los de diseño tradicional.

InternacionalPolítica & Economía MGIMOCiencia & Tecnología

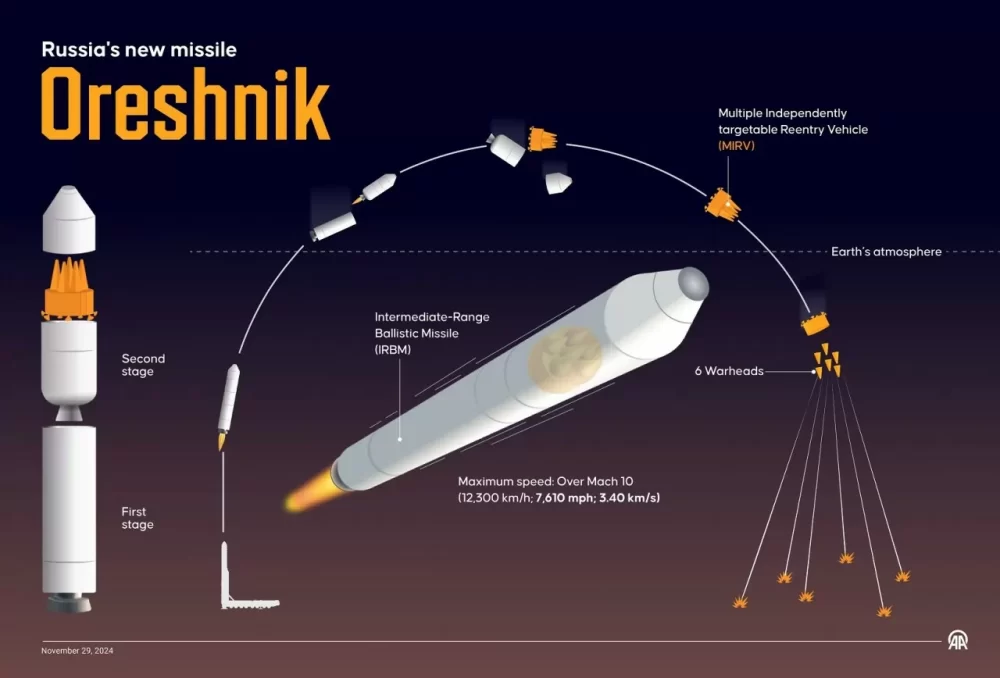

Oréshnik, el misil de Rusia que cambia las reglas del juego

Rusia ha puesto en marcha la producción en serie del misil balístico Oréshnik, un arma hipersónica de alcance intermedio capaz de evadir los sistemas de defensa antimisil. Su primera utilización en combate y su posible despliegue en Bielorrusia marcan un nuevo capítulo en la estrategia militar de Moscú. ¿Qué hace a este misil prácticamente imposible de interceptar?

Foto principal: Sistema de misiles balísticos RS-24 Yars del ejército ruso avanza por la Plaza Roja durante el desfile militar por 80 aniversario de la Victoria sobre la Alemania nazi en la Gran Guerra Patria.

Oréshnik: El Nuevo Misil Balístico Ruso De Alcance Intermedio

El 21 de noviembre de 2024, el presidente ruso Vladímir Putin confirmó por primera vez el uso del misil balístico de alcance intermedio (IRBM) Oréshnik. Según el mandatario, las fuerzas rusas emplearon la versión hipersónica no nuclear del arma para atacar un complejo militar-industrial en Dnipro.

Al día siguiente, Putin aseguró que Rusia disponía de un stock operativo de estos misiles y que su producción en serie ya estaba en marcha. Además, subrayó que Oréshnik no es una modernización de los sistemas soviéticos, sino un desarrollo totalmente nuevo basado en tecnologías modernas.

Las Capacidades De Oréshnik

Según datos oficiales, Oréshnik es actualmente el único misil balístico de alcance intermedio (IRBM) en servicio en las fuerzas armadas rusas. De acuerdo con el portal gubernamental Obyasnayem.rf, el arma tiene un alcance máximo de 5.500 kilómetros y puede alcanzar velocidades de hasta Mach 10, es decir, aproximadamente 12.400 kilómetros por hora o 3 kilómetros por segundo. Su capacidad de carga explosiva llega a 1,5 toneladas y puede equiparse con ojivas nucleares de hasta 900 kilotones, equivalentes a 45 bombas como la de Hiroshima.

El 28 de noviembre, durante la cumbre de la Organización del Tratado de Seguridad Colectiva (OTSC), el presidente Vladímir Putin afirmó que Oréshnik es capaz de alcanzar objetivos altamente protegidos y situados a gran profundidad. Según el mandatario, la temperatura de las ojivas puede alcanzar los 4.000 grados Celsius, lo que, sumado a su capacidad de portar múltiples ojivas autodividibles que viajan a Mach 10, convierte su uso masivo en un poder destructivo comparable al de un ataque nuclear.

Oréshnik solo puede ser derribado en la fase inicial de su trayectoria, lo que explica su lanzamiento desde el cosmódromo de Kapustin Yar, en la provincia de Astracán, trascienden fuentes oficiales. En la fase final, cuando la velocidad de la ojiva alcanza su punto máximo, la interceptación se vuelve prácticamente imposible.

Las estimaciones indican que el tiempo de vuelo de Oréshnik hasta la base de defensa antimisil de EE.UU. en Redzikowo (Polonia) es de 11 minutos. Hasta la base aérea de Ramstein (Alemania) tardaría 15 minutos, y hasta la sede de la OTAN en Bruselas, 17 minutos.

Uso En Combate Y Producción

El 21 de noviembre de 2024, Rusia empleó por primera vez el misil balístico Oréshnik en un ataque contra una fábrica de misiles en Dnipro (antes Dnipropetrovsk). Según fuentes oficiales, la operación fue una represalia por el uso de misiles ATACMS y Storm Shadow por parte de Ucrania en ataques contra instalaciones en las regiones rusas de Briansk y Kursk.

El presidente Vladímir Putin anunció el inicio de la producción en serie de Oréshnik el 22 de noviembre y, días después, el 28 de noviembre, confirmó que Rusia ya disponía de varios misiles listos para su uso.

El 6 de diciembre, Putin declaró que Rusia planea suministrar el sistema de misiles Oréshnik a Bielorrusia, esto probablemente ocurriría durante el segundo semestre de 2025. Según el mandatario, el arma formará parte del complejo de Tropas de Misiles de Designación Estratégica de las Fuerzas Armadas rusas, pero la decisión sobre sus objetivos recaerá en Minsk.

Asesoría y Corrección: Bricslat (Argentina)

Fuentes:

- https://www.rbc.ru/base/28/11/2024/67486cbd9a79473abf02b59b

- https://t.me/SputnikARM/80084

- https://vstatic.vietnam.vn/vietnam/resource/IMAGE/2025/1/19/1146a4fc0de84e5f990d28d093868d2e

- https://www.youtube.com/watch?v=F7a2i_TIMDg

San JuanCiencia & Tecnología

San Juan tendrá un nuevo telescopio que permitirá controlar la basura espacial

Este importante avance será posible gracias a un convenio histórico de cooperación entre la Facultad de Ciencias Exactas, Físicas y Naturales y la Agencia Espacial Italiana.

San Juan será escenario de un avance sin precedentes en materia astronómica. Se trata de la instalación en la Estación Astronómica de Altura Carlos Cesco, en Barreal, de un telescopio FlyEye destinado a la observación y vigilancia de basura espacial. Y que será el primero de este tipo en la provincia. Esta acción será posible gracias a un convenio entre la Facultad de Ciencias Exactas, de la UNSJ, y la Agencia Espacial Italiana (ASI). Natalia Nuñez, decana de esta unidad académica, adelantó que el proyecto se encuentra en una ‘etapa avanzada de desarrollo’.

El pasado 26 de mayo, la decana Nuñez y el director del Observatorio Felix Aguilar, Carlos Francile, recibieron la visita de una delegación de alto nivel de la Agencia Espacial Italiana para avanzar en el convenio histórico que permitirá la instalación de este telescopio, que va camino a la concreción. Es por este motivo que en la reunión también participó Marcelo Colazo, gerente de Vinculación Tecnológica de CONAE (Comisión Nacional de Actividades Espaciales) y representantes de la empresa contratada para la instalación del nuevo telescopio de un metro de diámetro y equipado con tecnología de vanguardia y un amplio campo visual que lo convierten en una herramienta clave para identificar y seguir la trayectoria de residuos espaciales, un aspecto crucial para la seguridad de misiones orbitales. ‘Con la visita de los representantes de ASI la semana pasada, pudimos terminar de darle forma al convenio para que lo firme el Rector de la universidad. Sólo nos faltaba definir el lugar exacto donde se instalará este nuevo instrumental en la Estación Cesco. Ya se definió y el proyecto avanza’, sostuvo Natalia Nuñez.

La decana también agregó que este convenio de cooperación establece que ASI aportará el nuevo telescopio y asumirá los gastos de la construcción de la infraestructura necesaria para su instalación, mientras que la Estación Cesco, dependiente de la UNSJ, cederá en comodato el espacio para construir el edificio que albergará el equipo y otro anexo para su ensamble, como también se hará cargo de su mantenimiento.

Si bien el telescopio que detecta basura espacial aún no ha sido trasladado al país, ya comenzaron a planificar las obras para su instalación, que incluyen la construcción de una cúpula especializada. Se estima que los trabajos comenzarán a principios de 2026, mientras que la fase previa de diseño y preparación concluiría entre septiembre y octubre de este año. ‘La instalación de este nuevo equipo nos permitirá seguir potenciando lazos de colaboración tanto con la CONAE como con ASI y nos abre un área en la que aún no hemos trabajado como es el tema relacionado con los desechos espaciales que se conecta con otras áreas como son la agronomía y la temática de los satélites. Esto representa un gran avance para la UNSJ y para San Juan en materia de capacitación e investigación’, dijo Nuñez.

La decana agregó que este convenio representa el primer acuerdo de cooperación entre la UNSJ y la ASI y que se encuentra en la fase final de revisión administrativa. Y que tras ser evaluado por la universidad, la agencia italiana y la CONAE, resta la aprobación por parte de las cancillerías de Argentina e Italia que ya dieron su visto bueno. Es por esto que se estima que la formalización del acuerdo se concretará entre junio y julio de este año.

Este proyecto de cooperación fue presentado oficialmente el pasado 31 de marzo ante el Consejo Directivo de la Facultad, durante una sesión especial realizada en la Estación Astronómica con motivo de su 60º aniversario.

> Planes futuros

Natalia Nuñez, decana de la Facultad de Exactas, dijo que se creará un programa para que alumnos avanzados de Astronomía puedan realizar pasantías y capacitaciones con el nuevo telescopio detector de residuos espaciales. También podrán hacerlos los jóvenes investigadores.

/DC

San JuanEducaciónCiencia & Tecnología

Se entregó el premio del concurso «Paseo ConCiencia»

Se trata de un programa de innovación tecnológica promovido en conjunto entre el Ministerio de Producción, Trabajo e Innovación y el Municipio de Rivadavia.

El concurso «Paseo ConCiencia» se trata de la presentación de propuestas para aprovechar espacios públicos como lugares de encuentro y aprendizaje, teniendo en cuenta la ciencia y la tecnología como herramientas para promover el pensamiento crítico, la creatividad y el desarrollo de habilidades científicas y tecnológicas.

El concurso busca, además, incentivar la participación de profesionales, inventores e instituciones educativas. Los postulantes diseñaron juegos y atracciones interactivas que permitan demostrar algún principio científico-tecnológico para implementar en paseos, plazas y parques.

En esta oportunidad, la Secretaría de Ciencia, Tecnología e Innovación hizo entrega de una Tablet a las ganadoras de la categoría institución educativa, destacando a las alumnas María Luz Becerra, María Paz Manzano y Ana Toridandel pertenecientes al 3° año de formación general del ciclo básico de secundaria del Colegio Inglés Bilingüe quienes elaboraron el proyecto dentro de la materia de artes visuales y fueron guiadas por la profesora Débora Lucía Bazán Flitt. Asimismo, tendrán la posibilidad de participar en talleres de robótica productiva

En relación al material elaborado, las estudiantes detallaron que el proyecto se trata de un laberinto de colores con un círculo cromático en el medio del dispositivo donde las personas puedan aprender sobre distintos inventos de Newton, la teoría del color, y un poco de tecnología gracias a los QR.

También comentaron que lo desarrollado tiene como objetivo intervenir lúdicamente un espacio público al aire libre con dispositivos tridimensionales diseñados para enseñar la teoría del color de manera interactiva y pedagógica. Los estudiantes de 3er año de secundaria del curso de Artes Visuales han desarrollado maquetas que aplican los conceptos aprendidos en clase, desde los aportes de la Isaac Newton a la colorimetría hasta los avances contemporáneos en el ámbito científico; transformando la plaza y/o el paseo en un espacio educativo y divertido para toda la comunidad.

/PrensaLegislatura

-

![]() Sociedad 2 meses ago

Sociedad 2 meses agoUn nene de 8 años fue a jugar con amiguitos pero no volvió: apareció a las 4 de la madrugada a 3 kilómetros de su casa

-

![]() Nacional / Política & Economía 2 meses ago

Nacional / Política & Economía 2 meses agoDesde este lunes los sanjuaninos pueden solicitar la nueva Licencia de Conducir Digital: cómo es el trámite online

-

![]() Sociedad / Sucesos 2 meses ago

Sociedad / Sucesos 2 meses agoEncontraron el cuerpo sin vida del jachallero que estaba desaparecido

-

![]() Sociedad / Sucesos 2 meses ago

Sociedad / Sucesos 2 meses agoMurió un joven de 16 años: chocó de frente contra un poste

-

![]() Espectáculos 2 meses ago

Espectáculos 2 meses agoMaría Valenzuela fue internada de urgencia en un centro de salud mental: qué le pasó

-

![]() San Juan / Política & Economía 2 meses ago

San Juan / Política & Economía 2 meses agoLegislatura de San Juan: se prepara para la entrega de la “Mención de Honor Maestro Mario Pérez” 2024

-

Sociedad 2 semanas ago

Sociedad 2 semanas agoUna iglesia evangélica es sacudida por la denuncia de un fraude multimillonario con el dinero de los diezmos

-

![]() San Juan / Política & Economía 2 meses ago

San Juan / Política & Economía 2 meses agoAclaran que todavía en San Juan el trámite para sacar la licencia de conducir es presencial